Un jour de mars, au beau milieu d’une journée de travail ordinaire, Kate, 28 ans, a senti un tapotement pressé sur son épaule. Son collègue voulait absolument lui montrer une vidéo. Elle s’est donc approchée de son écran et s’est vue, grimaçante et gémissante, sur un canapé, les jambes écartées, tandis qu’un homme la pénétrait.

Kate était écœurée. Ses collègues, venus voir ce qui se passait, en sont restés sans voix. Ça avait l’air vraiment réel. La fille dans la vidéo répondait même au prénom de Kate. Évidemment, elle savait que ça ne pouvait pas être elle puisqu’elle n’avait jamais fait de film porno, et que le corps n’était pas le sien. Il ne pouvait s’agir que d’un canular, mais qui la croirait?

«C’était horrible. Je n’avais jamais rien vu de semblable», explique Kate, qui vit au Texas.

La vidéo, qui est toujours en ligne et compte des dizaines de milliers de vues, est un «deepfake», une vidéo trafiquée à l’aide d’un logiciel d’intelligence artificielle qui donne l’impression que quelqu’un fait ou dit des choses. Ces algorithmes utilisent les données vidéo et images d’un individu pour créer un modèle virtuel de son visage et le superposer à n’importe quelle image. Dans le cas de Kate, son visage a été superposé sur celui d’une actrice porno.

«Avec Photoshop, qui permet de modifier une image statique, on voit la supercherie», explique Kate, qui avait déjà été la cible d’attaques misogynes. «Mais quand votre propre visage réagit et bouge, c’est absolument déconcertant. Vous vous rendez compte que vous n’avez aucun contrôle sur l’utilisation qui est faite de votre image.»

Au début, le «deepfake» porno s’attaquait presque exclusivement aux célébrités féminines, leurs apparitions à la télévision et au cinéma constituant suffisamment de matériel exploitable pour les auteurs de vidéos. Aujourd’hui, la technologie a évolué. Elle est plus accessible, faisant de toutes les femmes des cibles potentielles puisque quelques photos ou vidéos publiques suffisent.

Six femmes dont le visage a été inséré dans un film porno sans leur consentement ont décidé de s’exprimer pour sensibiliser le public à un problème ignoré depuis trop longtemps par les médias (nous avons changé leur nom pour protéger leur vie privée).

La plupart des débats sur le «deepfake» s’intéressent à son utilisation malveillante dans la sphère politique. Il constitue pourtant une menace réelle et actuelle pour les femmes. À un an des élections présidentielles américaines, les législateurs se sont inquiétés de la diffusion possible de vidéos truquées où un candidat tiendrait des propos diffamatoires. Les «deepfakes» satiriques d’Arnold Schwarzenegger et de Mark Zuckerberg ont récemment fait les gros titres et donné un avant-goût du pire à venir.

Pendant ce temps, le «deepfake» porno continue de bouleverser la vie des femmes. Les médias n’en parlent quasiment pas et il n’existe toujours aucun recours pénal pour les victimes.

«Ce type d’objectivation sexuelle qui porte préjudice aux femmes a lieu en ce moment même», nous dit Mary Anne Franks, professeure de droit à l’Université de Miami et présidente de la Cyber Civil Rights Initiative. «C’est comme si les gens avaient oublié que cette technologie avait commencé par des pratiques misogynes. Et plus personne n’en parle».

Les «deepfakes»: une arme misogyne

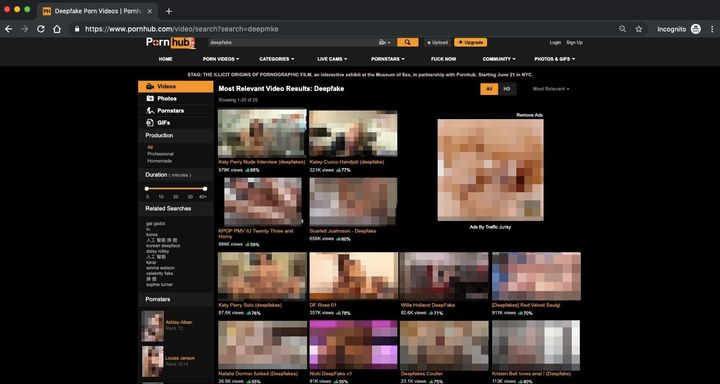

Depuis le début, les «deepfakes» visent les femmes. Le terme «deepfake» a été inventé en 2017 par un utilisateur anonyme de Reddit qui a partagé des vidéos porno truquées, comme celle ci-dessus, avec Gal Gadot, l’actrice qui incarne Wonder Woman au cinéma. Aujourd’hui, les principaux sites pornos regorgent de «deepfakes», malgré les promesses d’interdiction. MindGeek, propriétaire de Pornhub et d’autres sites de vidéos pornos, a refusé, malgré des demandes répétées, de s’exprimer sur sa politique anti-«deepfakes», annoncée il y a plus d’un an.

Face aux «deepfakes» hébergés sur leurs sites, d’autres plateformes hésitent entre le fait de satisfaire aux demandes de suppression des contenus truqués et protection de la liberté d’expression. Au sein du gouvernement fédéral, les législateurs ont commencé à tirer la sonnette d’alarme et présenté des projets de loi pour les réglementer, tels que la loi DEEPFAKES Accountability Act proposée par la députée Yvette Clarke, de l’État de New York. Jusqu’à présent, aucune n’a été voté.

“Une fois en ligne, il est quasi impossible de supprimer quoi que ce soit car le contenu est republiable à l’infini.”

- Tina, victime d’un deepfake pornographique.

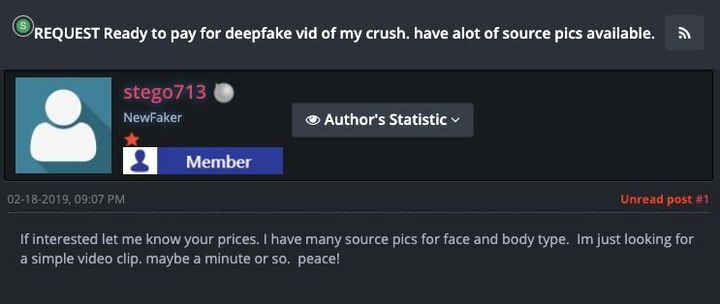

Sans interventions ou politiques efficaces, le «deepfake» porn a su se tailler une place de choix en ligne et connaît un véritable essor. Outre les applications gratuites et faciles à utiliser, il existe désormais des moteurs de recherche de photos (que nous ne citerons pas) qui permettent aux utilisateurs de télécharger des photos d’individus à superposer sur les visages d’actrices porno aux traits similaires pour des résultats optimaux. Il existe même des forums où le «deepfake» est vendu comme un service payant: des hommes partagent les profils de femmes sur les réseaux sociaux pour fournir des images source qui serviront à la fabrication de vidéos porno de qualité professionnelles. Nous avons constaté que certaines demandes concernent des influenceuses sur Twitch, YouTube et Instagram, mais aussi d’anciennes collègues, amies et compagnes.

En mars, dans l’un de ces forums, quelqu’un a demandé une vidéo de Tina, une jeune Canadienne de 24 ans, et copié un lien vers sa chaîne YouTube. Quatre jours plus tard, un «deepfake» la montrait nue, penchée en avant, en train de se faire sodomiser pendant qu’un autre homme se masturbait près de son visage. La vidéo, hyperréaliste, est toujours en ligne et compte des milliers de vues.

«J’étais sous le choc et très perturbée», dit Tina, qui a appris l’existence de la vidéo par une connaissance. «C’était vraiment bizarre et dégueulasse de voir mon visage là où il ne devait pas être.»

Celui qui a publié la vidéo et qui s’en revendique l’auteur est, selon son profil, un homme d’âge moyen que Tina ne connaît absolument pas. Elle a pensé à faire supprimer la vidéo mais, lorsqu’elle a réalisé qu’elle avait déjà été partagée sur d’autres sites, elle s’est dit que c’était peine perdue.

«Vous savez comment fonctionne internet; une fois en ligne, il est quasi impossible de supprimer quoi que ce soit car le contenu est republiable à l’infini.»

Ça peut arriver à n’importe qui

Jusqu’à récemment, seuls des monteurs expérimentés pouvaient truquer des vidéos de manière convaincante. Pour insérer numériquement des acteurs décédés dans un film, les cinéastes hollywoodiens avaient besoin d’une quantité considérable d’enregistrements du visage de l’acteur. Aujourd’hui, la technologie se développe rapidement et a démocratisé ce type de pratique aux dépens des femmes. Nous sommes parvenus à un point où même les amateurs, à l’aide de quelques images seulement du visage de leur cible, réussissent eux-mêmes à créer du «deepfake» porno.

Un vidéaste autoproclamé, qui se présente en ligne comme un jeune homme grec de 25 ans et «l’un des pionniers» du «deepfake» porno, sollicite des dons et propose des services payants sur plusieurs forums. Ses vidéos ont été vues plus de 300 000 fois.

«Le “deepfake” n’est pas différent d’une manipulation dans Photoshop ou d’un dessin ou rendu artistique», nous dit-il. Lorsqu’on lui demande si quelqu’un a déjà sollicité la suppression des vidéos qu’il met en ligne, il répond: «On ne supprime jamais rien.»

Bien qu’indifférent à la protection de la vie privée des femmes, il est très préoccupé par la sienne: «J’accepte les paiements en bitcoins et dans d’autres cryptomonnaies (pas de carte bancaire pour des raisons de confidentialité)», écrit-il dans un message. Avant d’indiquer dans un autre que sa fourchette de prix se situe entre 15 et 40 dollars par vidéo.

«Une femme peut dire à un homme qu’elle ne veut pas sortir avec lui, faire sa connaissance, se déshabiller pour lui. Mais il peut maintenant répondre: “Ah, oui? Je vais te forcer à le faire, et si je ne peux pas le faire physiquement, ce sera virtuellement», explique Mary Anne Franks. «La seule manière de se protéger, c’est de ne pas exister sur internet.»

Elle espère qu’en alertant le public sur l’existence des «deepfakes», notamment de nature pornographique, les gens s’interrogeront sur ce qu’ils voient en ligne. «Le seul point positif, si tant est qu’il y en ait un, c’est que plus les gens seront au courant, plus ils se demanderont si les [vidéos de “revenge porn”] sont réelles.»

Le «deepfake» a en effet augmenté la menace du «revenge porn», ou porno non consensuel. Un sale type n’a plus besoin de photos dénudées ou de «sex-tapes» d’une femme qui l’a rejeté. Les photos publiées sur son profil Facebook ou Instagram suffisent pour les intégrer à un porno existant. Et plus la réalisation de ces vidéos se simplifie, plus l’identification des vidéos truquées devient difficile.

“La seule manière de se protéger, c’est de ne pas exister sur internet.”

- Mary Anne Franks, présidente de Cyber Civil Rights Initiative.

Comme beaucoup de femmes, Amy, mère et chef d’entreprise à Los Angeles, a déjà été harcelée avec des images grossièrement modifiées qui étaient troublantes mais clairement fausses. Elle n’avait jamais entendu parler de «deepfakes» avant de figurer dans un film où elle avait des relations sexuelles et se faisait traiter de «salope». Dans les commentaires, certains internautes ont félicité son auteur anonyme pour la vraisemblance des images.

«Tant qu’on voyait parfaitement que ce n’était pas moi, c’était moins préoccupant. Mais la technologie et les compétences de ceux qui l’utilisent ont évolué au point qu’aujourd’hui les gens peuvent croire que c’est bien moi», explique-t-elle. «Lorsqu’on voit une vidéo, on la considère comme factuelle.»

La Defense Advanced Research Projects Agency (DARPA), branche du ministère américain de la Défense, s’emploie depuis plusieurs années à développer des algorithmes d’apprentissage automatique capables de détecter les vidéos truquées. La plus grande difficulté consiste à évoluer au même rythme que les logiciels de «deepfake».

«Les auteurs de ces vidéos savent de mieux en mieux utiliser leurs outils et nous devons parfaire l’utilisation des nôtres», explique Edward Delp, expert en criminologie des médias à Purdue University, qui mène des recherches pour le compte de la DARPA. «C’est un véritable bras de fer.»

Aucune véritable option pour les victimes

Maya, une jeune femme de 29 ans qui vit également à Los Angeles, ne savait pas qu’elle apparaissait dans un «deepfake» porno jusqu’à ce que nous la contactions la semaine dernière. Bien que consternée de voir que la vidéo qui la montre en train de se masturber l’identifiait par son nom, elle n’a pas été entièrement surprise: elle a en effet reçu ces derniers temps de nombreux messages d’inconnus lui proposant des relations sexuelles.

«Ça fait vraiment bizarre d’être la victime d’une violation de son intimité», nous dit-elle. «L’idée que les gens me sexualisent me donne l’impression d’être fétichisée, de recevoir une attention non désirée, de ne plus être respectée en tant que personne et de ne plus être en sécurité.»

La triste réalité pour toutes les femmes dans sa situation, c’est qu’elles ne peuvent pas faire grand-chose. Les poursuites peuvent coûter extrêmement cher. Et pour intenter une action en justice pour harcèlement, usurpation d’identité, diffamation ou détournement d’image — qui ne concerne généralement que les célébrités —, il faut d’abord savoir qui poursuivre. Comme beaucoup de victimes de «deepfakes» pornos, Maya n’a aucune idée de l’auteur de la vidéo.

Et comme les fournisseurs d’accès à internet, y compris les géants des médias sociaux et les forums de «deepfake», sont dégagés de toute responsabilité vis-à-vis du contenu publié par des tiers, conformément à l’article 230 du Communications Decency Act, poursuivre en justice les sites hébergeant la vidéo serait vain. Les plateformes ne risquent rien d’un point de vue judiciaire pour ce que leurs utilisateurs publient, et elles n’ont aucune obligation de les supprimer. En conséquence, il est souvent inutile d’essayer d’obtenir la suppression de contenu abusif.

«Aussi décevant que cela puisse paraître – et cela donne à réfléchir –, les victimes ont peu de recours possible», précise Carrie Goldberg, avocate spécialisée dans la protection de l’intimité sexuelle. Les sites de “deepfakes” existent «pour monétiser l’humiliation d’êtres humains», ajoute-t-elle. «Ça soulève le problème de l’art. 230 qui permet aux sites de se retrancher derrière leur immunité.»

Comme les «deepfakes» malveillants sont généralement publiés de manière anonyme et conçus pour devenir viraux, les défenseurs des victimes, dont Danielle Citron fait partie, exhortent les législateurs à élaborer une politique visant non seulement à punir les auteurs mais également les diffuseurs. Elle travaille, avec Mary Ann Franks, à la rédaction d’un projet de loi pénale fédérale qui tiendrait les plateformes responsables d’amplifier sciemment le phénomène des vidéos truquées et leur diffusion.

«Si les usurpations d’identité ou les manipulations sont avérées, les plateformes devront les supprimer quand elles en sont informées», a indiqué Danielle Citron, professeur de droit à l’Université du Maryland, lors de la première audience du Congrès sur le «deepfake». À ce stade, notait-elle, il n’existe aucun moyen de filtrer les vidéos publiées; les plateformes doivent donc être contraintes de les supprimer dès qu’elles ont été signalées.

Les défenseurs de la liberté d’expression craignent, à moins d’agir avec beaucoup de prudence, que le fait d’obliger les sites à limiter leurs contenus ait des répercussions plus importantes sur l’expression en ligne.

Or, comme Mary Ann Franks l’a expliqué, l’épidémie de «deepfakes» pornographiques le fait déjà.

Selon elle, «ils ont un effet paralysant sur le discours des femmes car le meilleur moyen de se protéger est de s’autocensurer».

Les femmes sont réduites au silence

La journaliste d’investigation Rana Ayyub connaît personnellement cet effet de musellement. Au printemps dernier, en Inde, elle a été victime d’une campagne de désinformation ciblée visant à l’intimider et à l’humilier.

Vingt-quatre heures après avoir condamné publiquement la réaction honteuse d’un parti politique au viol d’une jeune fille, des captures d’écran montrant une série de tweets diffamatoires prétendument écrits par elle ont commencé à circuler en ligne. Puis une vidéo porno truquée, avec son nom et son numéro de téléphone, a tourné sur les réseaux sociaux, générant des centaines de milliers de vues et une salve d’appels et de messages à caractère sexuel.

«J’étais anéantie», a-t-elle confié au HuffPost britannique. «Tout le pays regardait une vidéo porno où mon visage apparaissait, et je ne savais pas quoi faire.»

Même si la vidéo a été reconnue truquée depuis, Rana Ayyub ne pourra jamais vraiment tourner la page. Elle ne peut pas réparer les torts causés à sa réputation et craint de trop attirer l’attention sur les réseaux sociaux.

«J’avais l’habitude de donner mon avis sur tout. Aujourd’hui, je suis beaucoup plus prudente sur ce que je publie en ligne. Je me suis un peu autocensurée par nécessité. Je me demande sans cesse si quelqu’un va de nouveau s’en prendre à moi?»

Kate, dont le collègue avait découvert le «deepfake» porno, a également eu du mal à tourner la page. Son avocat lui a expliqué que le dossier serait extrêmement difficile à défendre car elle ne savait pas qui était l’auteur de la vidéo.

En l’absence de recours légaux viables, Kate s’est tournée à contrecœur vers le forum de «deepfake» où la vidéo a été publiée et a demandé à ce qu’elle soit supprimée. Le propriétaire du site lui a dit qu’elle n’était pas la seule femme sur la page, puis a cessé de lui répondre. Elle s’est sentie impuissante.

«C’est monstrueux de savoir que la vidéo est en ligne et que je ne peux rien y faire. Le résultat est tellement bluffant que c’est facile d’y croire. Je n’ai qu’une envie: crier que ce n’est pas moi. Mais je ne ferais qu’attirer encore davantage l’attention.»

Comme Rana Ayyub, Kate a commencé à limiter ce qu’elle partage en ligne, de peur que son contenu soit déformé et utilisé contre elle sans possibilité de poursuites.

«Les “deepfakes” pornos, revenge porn et autres contenus du même genre vont pousser les femmes à s’autocensurer. On assiste à une véritable prolifération de ces vidéos et elles sont de plus en plus hyperréalistes. Est-ce le prix que les femmes sont censées accepter de payer en échange de leur présence sur le Web?» s’interroge-t-elle.

Cet article, publié sur le HuffPost américain, a été traduit par Karine Degliame-O’Keeffe pour Fast ForWord.